数据治理 数据集成与数据分析处理

在当今数据驱动的时代,数据治理已成为企业提升数据价值、保障数据安全的关键手段。数据治理涵盖了数据管理的方方面面,其中数据集成为基础,数据分析与处理为核心应用,共同构建了高效、可靠的数据体系。

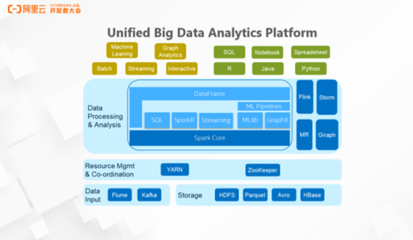

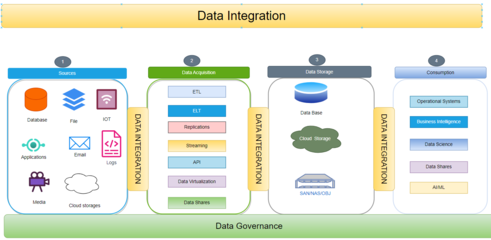

数据集成是指将来自不同来源、格式和系统的数据进行整合,形成统一、一致的数据视图。其重要性在于解决数据孤岛问题,提高数据的可用性和一致性。数据集成的常见方法包括:ETL(抽取、转换、加载)、数据虚拟化和API集成。例如,企业通过ETL工具将销售系统、客户关系管理系统和财务系统的数据进行整合,以支持跨部门业务分析。数据集成也面临数据质量、兼容性和实时性等挑战,需要结合数据治理框架制定标准化流程。

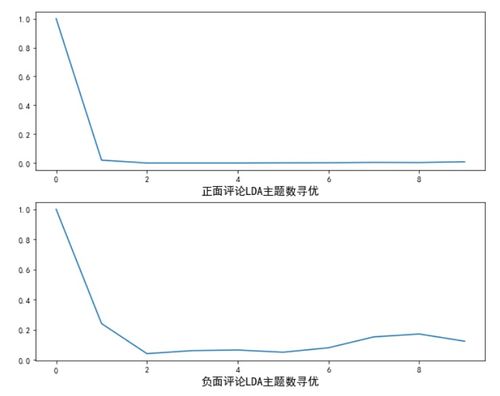

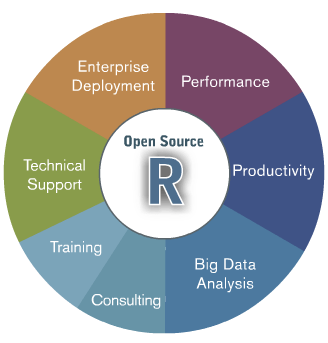

数据分析与处理是数据治理的延伸,旨在从集成后的数据中提取洞察,支持决策和创新。数据分析包括描述性分析(如数据汇总)、诊断性分析(如因果探索)、预测性分析(如机器学习建模)和规范性分析(如优化建议)。数据处理则涉及数据清洗、转换和存储,以确保数据适用于分析。例如,通过大数据平台处理海量日志数据,分析用户行为模式,优化产品体验。这一过程需要借助工具如Hadoop、Spark和数据可视化软件,并遵循数据治理原则,确保数据隐私和合规性。

数据集成与数据分析处理相互依存:高效的数据集成为分析提供高质量输入,而深入的分析又反哺数据治理,识别数据问题并优化集成策略。企业应建立全面的数据治理策略,包括制定数据标准、实施监控机制和培养数据文化,以最大化数据价值。最终,通过持续优化数据集成与分析流程,组织能够实现数据驱动的转型,在竞争中脱颖而出。

如若转载,请注明出处:http://www.iata-boms.com/product/1.html

更新时间:2025-11-28 00:25:14